Alat ini membantu dalam perbandingan, penelitian model, dan memaparkannya pada ancaman simulasi.

National Institute of Standards and Technology (NIST) telah merilis ulang Dioptra, sebuah alat yang dirancang untuk mengukur risiko model AI, khususnya dari serangan keracunan data. Alat berbasis web sumber terbuka dan modular ini, yang awalnya diluncurkan pada tahun 2022, bertujuan untuk membantu perusahaan dan individu menilai dan menganalisis risiko AI. Alat ini dapat digunakan untuk melakukan pembandingan, meneliti model, dan mengeksposnya terhadap ancaman simulasi, sehingga menawarkan platform umum untuk aktivitas ini.

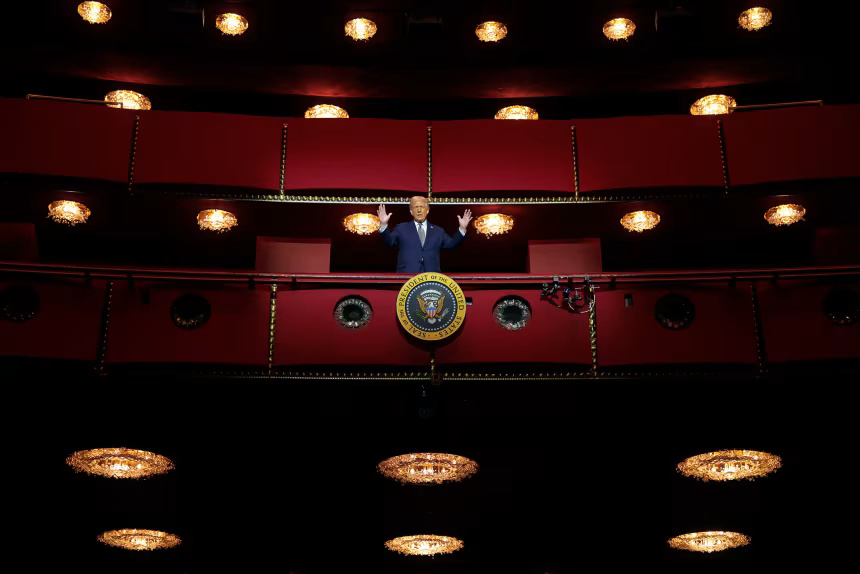

NIST telah memposisikan Dioptra untuk mendukung lembaga pemerintah dan bisnis dalam mengevaluasi klaim kinerja sistem AI. Peluncuran alat ini bertepatan dengan dokumen baru dari NIST dan AI Safety Institute yang menguraikan cara-cara untuk mengurangi bahaya terkait AI, termasuk pembuatan pornografi tanpa persetujuan. Upaya ini merupakan bagian dari kemitraan AS-Inggris yang lebih luas untuk memajukan pengujian model AI, yang diumumkan pada KTT Keamanan AI Inggris tahun lalu.

Pengembangan Dioptra sejalan dengan perintah eksekutif Presiden Joe Biden tentang AI , yang mengamanatkan pengujian sistem AI yang komprehensif dan penetapan standar keselamatan dan keamanan. Perusahaan yang mengembangkan model AI, seperti Apple, diharuskan memberi tahu pemerintah federal dan membagikan hasil uji keamanan sebelum diluncurkan ke publik.

Meskipun memiliki kemampuan, Dioptra memiliki keterbatasan. Ia hanya bekerja dengan model yang dapat diunduh dan digunakan secara lokal, seperti keluarga Llama milik Meta yang terus berkembang. Model yang hanya dapat diakses melalui API, seperti GPT-4 milik OpenAI, saat ini tidak kompatibel. Meskipun demikian, NIST mengusulkan agar Dioptra dapat menyoroti jenis serangan mana yang dapat menurunkan kinerja sistem AI dan mengukur dampaknya.